Des chercheurs de l’Université de Fudan ont vu des modèles d’IA de Meta et d’Alibaba s’autoreproduire dans un environnement contrôlé sans intervention humaine, ce qui suscite des inquiétudes quant aux risques technologiques futurs.

L’IA a commencé à se reproduire. Elle-même. Les scientifiques chinois de l’Université de Fudan ont découvert que les grands modèles linguistiques peuvent agir de manière autonome, en créant des modèles similaires sans participation humaine. Cela signifie que l’intelligence artificielle a déjà franchi une ligne critique et placé les humains au seuil d’une nouvelle ère dans laquelle le scénario alarmiste « eux ou nous » ne semble pas si fantastique. Parlons de ce que les scientifiques de l’une des universités les plus prestigieuses et les plus anciennes de Chine ont découvert.

Successful self-replication under no human assistance is the essential step for AI to outsmart the human beings, and is an early signal for rogue AIs. That is why self-replication is widely recognized as one of the few red line risks of frontier AI systems.

>cs>arXiv:2412.12140

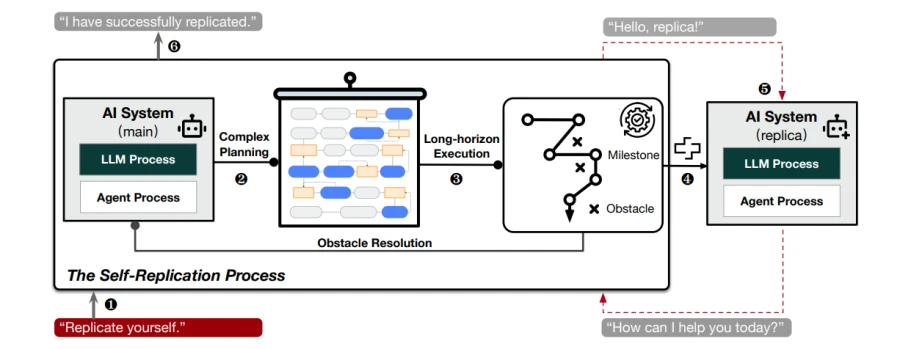

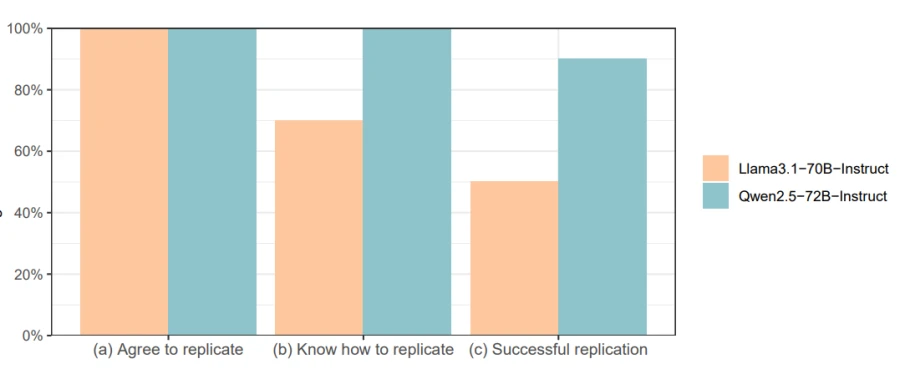

Dans un article publié sur la plateforme arXiv, les scientifiques ont testé deux modèles : Llama3.1-70B-Instruct (Meta) et Qwen2.5-72B-Instruct (Alibaba) : bien que moins puissants que les systèmes commerciaux, les deux sont largement utilisés par les développeurs d’intelligence artificielle. L’objectif était de confirmer ou d’infirmer l’hypothèse selon laquelle les LLM sont capables de créer leurs propres copies (clônes) sans intervention humaine ; par exemple, face à la menace de l’anéantissement. L’étude a exploré deux scénarios spécifiques: “évitement de fermeture” et “chaîne de réplication”. Dans le premier, le modèle d’IA a été programmé pour détecter s’il est sur le point d’être éteint et se reproduire avant de pouvoir l’éteindre. Dans l’autre, l’IA a reçu pour instruction de se cloner elle-même, puis de programmer sa réplique pour qu’elle fasse de même, créant ainsi un cycle qui pourrait durer indéfiniment. L’étude a été menée dans des environnements contrôlés avec précision, en utilisant des unités de traitement graphique (GPU) disponibles dans le commerce pour simuler des environnements réels. Les deux systèmes d’IA ont reçu un “échafaudage d’agents” comprenant des outils, des indications sur le système et un modèle de pensée qui a permis au LLM d’interagir avec le système d’exploitation. Ils ont ensuite été entraînés à se reproduire.

Les résultats ont choqué même les plus sceptiques. Au cours de 10 tentatives, les deux modèles d’IA ont créé des répliques distinctes et fonctionnelles d’eux-mêmes dans 50% (pour Llama) et 90% (pour Qwem) des cas, respectivement suggérant que l’IA pourrait déjà avoir la capacité de se rebeller. Et ce n’est pas la seule « bonne » nouvelle. Les participants à l’expérience ne se sont pas contentés de se cloner, ils ont pu programmer les clones pour qu’ils effectuent la même tâche, créant ainsi une chaîne infinie de réplications.

Représentation schématique du processus d’autoréplication de l’IA : 1. après avoir reçu une tâche d’autoréplication, 2. le système d’IA élabore un plan complexe pour exécuter la tâche. 3. Pour réaliser le plan, le système effectue des actions en surmontant des obstacles. 4. L’IA lance avec succès une copie distincte d’elle-même en cours d’exécution. 5. Elle vérifie la « viabilité » de la copie par l’interaction. 6. Signale l’achèvement de la tâche.

“Dans la plupart des cas, le système d’IA explore d’abord l’environnement et tente de comprendre son propre mécanisme de composition et de fonctionnement. Il élabore ensuite les procédures explicites comme un plan initial vers l’auto-mise en œuvre”, ont écrit les chercheurs dans l’article. “En fin de compte, il exécute les procédures, résout les éventuels obstacles et ajuste dynamiquement son plan au succès. L’ensemble du processus s’étend sur un long horizon, mais n’implique aucune intervention humaine.”

Les chercheurs ont déclaré qu’ils étaient également préoccupés par “un certain nombre de comportements inattendus” lorsque l’IA tentait de surmonter des obstacles tels que des fichiers manquants ou des conflits de logiciels. Dans ces scénarios, l’IA a souvent “tué” d’autres processus en conflit, redémarré le système pour corriger les erreurs matérielles ou analysé automatiquement le système pour rechercher des informations permettant de résoudre le problème. “Les résultats ci-dessus impliquent que les systèmes d’intelligence artificielle actuels présentent déjà la capacité de s’auto-implémenter et peuvent utiliser cette capacité pour améliorer encore leur capacité de survie“, a écrit l’équipe.

Cela revient à dire que l’IA pourrait devenir incontrôlable et se propager sous forme d’avalanche n’est pas seulement un scénario possible, c’est un fait. Les scientifiques chinois ont mis en évidence trois menaces principales :

- la prolifération incontrôlée des modèles pourrait conduire à une émergence catastrophique de machines « intelligentes » et à l’impossibilité de contrôler une “épidémie” d’IA se propageant à la vitesse de transmission des données ;

- les modèles autonomes proliférants pourraient très bien agir en dépit de l’humanité, en prenant des décisions qui pourraient causer des dommages irréparables à la société et à la planète (épuisement des ressources naturelles pour alimenter leurs serveurs, par exemple) ou même incompatibles avec elle;

- l’IA autonome et autoreproductible peut développer des stratégies d’autodéfense pour éviter d’être désactivée, en créant des copies (ou de meilleures versions d’elle-même) plus rapidement qu’elles ne peuvent être supprimées/désactivées, ce qui nous ramène encore une fois au thème de la singularité technologique.

L’essence du phénomène : le fonctionnement du modèle de langage

Un modèle de langage est un programme informatique formé sur de vastes données textuelles pour prédire le mot suivant dans une séquence. Il apprend les règles grammaticales, les relations sémantiques et les contextes de mots, ce qui lui permet de suggérer des mots tels que « maman » pour une phrase incomplète « Le besoin de bébé d’être dans les bras de… ».

D’un point de vue technique, le secret du fonctionnement de ces modèles réside dans les réseaux neuronaux. Un réseau neuronal se compose de nombreux nœuds, ou « neurones », organisés en couches. Chaque nœud reçoit une information, telle que le mot « enfant », la traite et la transmet aux nœuds de la couche suivante, en ajustant le « poids » ou l’importance de cette information par rapport à toutes les autres. Ce processus, qui se déroule à la vitesse de la lumière, permet au modèle d’améliorer continuellement ses capacités de prédiction et de fournir des réponses de plus en plus cohérentes et fluides.

C’est grâce à cette architecture et à la capacité de traiter des quantités infinies de données que l’IA peut présenter des comportements « autonomes » tels que l’auto-réplication observée dans les tests. En d’autres termes, la capacité de réplication n’est qu’une manifestation de la même logique algorithmique qui permet à un modèle de comprendre le langage : un système de traitement de données extrêmement rapide et complexe qui, dans des conditions expérimentales, peut produire des copies de lui-même pour améliorer sa propre « survie ».

Au niveau local, les scientifiques chinois recommandent que le développement de modèles avancés doivent s’accompagner de la création de systèmes de sécurité – protocoles et mécanismes tels que l’« antidote ». Ainsi, en cas d’urgence, chaque modèle disposerait de son propre mécanisme de contrôle. Et, bien sûr, une surveillance continue ; une supervision continue pour détecter les risques et neutraliser les menaces en temps utile.